Regressão Multi-Output com XGBoost em Python

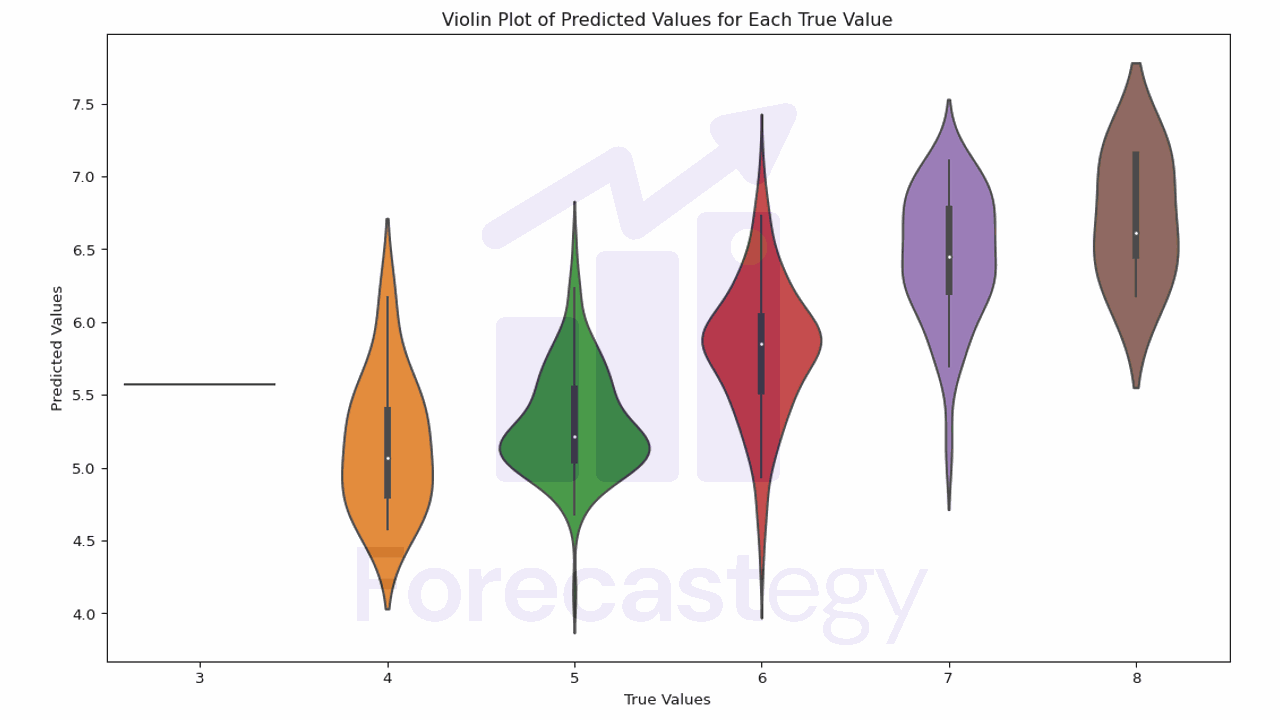

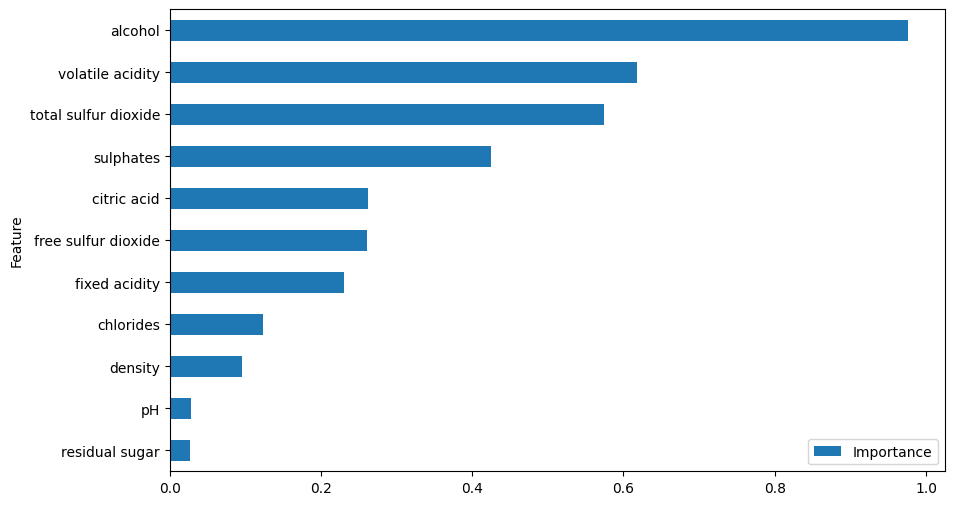

A regressão multi-output é uma tarefa de machine learning onde precisamos prever múltiplos valores para cada amostra de entrada. Imagine que você é um analista financeiro em uma empresa de investimentos. Seu trabalho é prever o desempenho futuro de várias ações para orientar decisões de investimento. Para cada ação, você quer prever vários alvos, como o retorno esperado, a volatilidade (risco) e a correlação com outras ações ou índices de mercado....